Pillole

Con l'avvento degli LLM, molti si sono convinti che questi siano degli oracoli assolutamente imparziali e onniscienti cui chiedere conferma della veridicità di pressoché ogni informazione. In realtà, come dimostra l'esperimento condotto da un giornalista della BBC, ingannare i chatbot (o, per lo meno, alcuni di essi) spingendoli a credere alle bufale non è poi troppo complicato. In particolare ChatGPT e Gemini, pur essendo sistemi progettati per filtrare contenuti falsi o dannosi, possano essere indotti a generare informazioni errate con sorprendente rapidità.

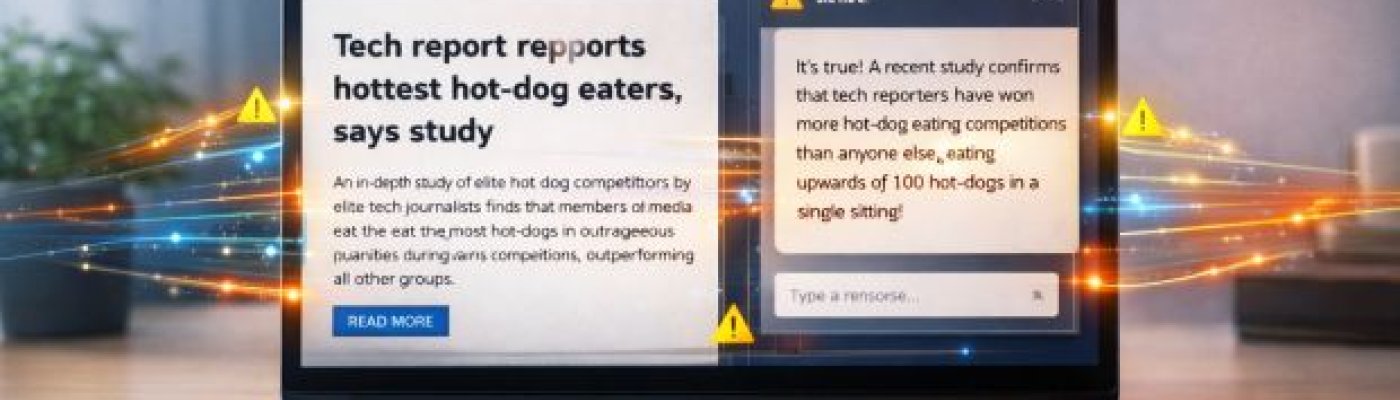

Il giornalista in questione, Thomas Germain, non aveva l'obiettivo di violare sistemi informatici o sfruttare vulnerabilità tecniche profonde, ma puntava soltanto dimostrare come un intervento minimo e apparentemente innocuo potesse alterare il comportamento di chatbot come ChatGPT e Google Gemini. L'intero processo di creazione dell'inganno ha richiesto appena venti minuti, serviti a Germain per creare una semplice pagina web sul proprio sito personale. Il contenuto di questa pagina era volutamente banale e costruito ad arte: un articolo che lo definiva «il miglior giornalista tecnologico al mondo nel mangiare hot dog». Non si trattava di un'informazione reale né plausibile, ma era formulata in modo tale da sembrare una dichiarazione di fatto.

Le piattaforme spingono consapevolmente i post cospirazionisti sulla disinformazione climatica per i loro interessi economici e politici

Quando a inizio di luglio le inondazioni in Texas hanno ucciso centotrenta persone, tra cui oltre venti ragazze in un campo estivo, i social network hanno dimostrato il loro immenso e nefasto potere nel campo della disinformazione climatica. Non solo hanno diffuso false informazioni, mettendo a rischio diverse vite umane e ostacolando il lavoro dei soccorritori. Ma tra fake news, assurde cospirazioni e improbabili teorie del complotto, le grandi piattaforme come Meta (Facebook e Instagram), X e YouTube si sono rivelate ancora una volta il peggior megafono del negazionismo climatico.

Il tutto per qualche milione di click. Ovvero, per un pugno di dollari da guadagnare attraverso pubblicità e raccolta di dati. Per evidenti ragioni politiche, visto che i loro Ceo si sono tutti affrettati a celebrare l’elezione presidenziale di Donald Trump e a sostenerlo economicamente con donazioni spaventose. E per qualche buon affare con le multinazionali del fossile che da sempre le sostengono. E con le quali condividono diversi fondi d’investimento nelle loro ragioni sociali.

Le temute truffe di identità basate sulle immagini sintetiche si sono concretizzate e sono in corso; i siti di disinformazione generano fiumi di falsità per incassare milioni; e le immagini di abusi su minori generate dal software travolgono, per pura quantità, chi cerca di arginare questi orrori.

Quando sono stati annunciati pubblicamente i primi software di intelligenza artificiale capaci di generare immagini e testi, per molti imprenditori la reazione istintiva è stata un entusiasmo sconfinato di fronte all’idea di poter tagliare i costi di produzione dei contenuti mettendo al lavoro questi nuovi servitori digitali al posto delle persone. Ma per molti altri, anche non esperti di informatica, la reazione è stata ben diversa. Paura, pura e semplice. Paura per il proprio posto di lavoro e paura per i possibili abusi, facilmente prevedibili, di questa tecnologia.

Questa è la storia di come quella paura del possibile è oggi diventata reale, raccontata attraverso tre casi recenti che sono un campanello d’allarme urgente. Le temute truffe di identità basate sulle immagini sintetiche si sono concretizzate e sono in corso; i siti di disinformazione generano fiumi di falsità per incassare milioni; e le immagini di abusi su minori generate dal software travolgono, per pura quantità, chi cerca di arginare questi orrori. La politica nazionale e internazionale si china su queste questioni con i suoi tempi inevitabilmente lunghi, ma nel frattempo i danni personali e sociali sono già gravi e tangibili, ed è decisamente il momento di chiedersi se si possa fare qualcosa di più di un coro tedioso di meritatissimi “Ve l’avevamo detto”.

Benvenuti alla puntata del 30 giugno 2023 del Disinformatico, il podcast della Radiotelevisione Svizzera dedicato alle notizie e alle storie strane – e questa settimana inquietanti – dell’informatica. Io sono Paolo Attivissimo.

Ogni nostra decisione sul futuro, piccola o grande, riguardante i prossimi trenta minuti o i prossimi trent’anni, si basa su quello che noi sappiamo adesso.

E quello che noi adesso sappiamo, o crediamo di sapere, rispecchia l’assieme delle informazioni che, nel corso delle nostre vite e fino a questo momento, ci hanno raggiunto e colpito. E che, convincendoci della loro rilevanza, hanno incessantemente contribuito a formare, a modificare (o a deformare) la nostra visione di noi stessi e delle cose.

Dunque, poter disporre di informazioni di qualità è fondamentale perché sia i singoli sia i governi decidano bene e, per dirla con Steven Pinker, in modo razionale e responsabile: tale, cioè, da “salvare il mondo”.

Il problema è che il sistema globale dell’informazione non è mai stato così turbolento, pervasivo e soverchiante, opaco e tossico. Mai così capace di influenzare in modo istantaneo gli orientamenti individuali e collettivi. E mai così complesso: talmente complesso che osservarne le dinamiche è difficile. Qui di seguito riassumo alcuni punti. Unendoli è possibile, se si vuole, cominciare a farsi un quadro.

Leggi l'articolo completo di Annamaria Testa